在數據科學的旅程中,數據的存儲與計算是構建可靠、高效分析流程的基石。本課程將圍繞整體流程、關鍵概念、數據庫選擇以及Lambda與Kappa架構展開,幫助你建立堅實的后端知識體系。

一、整體流程與核心概念

一個完整的數據處理流程通常遵循“數據采集 → 數據存儲 → 數據處理 → 數據分析/應用”的路徑。其中,數據存儲負責持久化保存原始數據和處理結果,而數據計算則涉及對數據進行清洗、轉換、聚合和分析。理解存儲與計算的分離與協同,是設計高效系統的關鍵。

二、數據庫的選型:因地制宜的策略

面對眾多數據庫,選型需基于數據特性與業務需求:

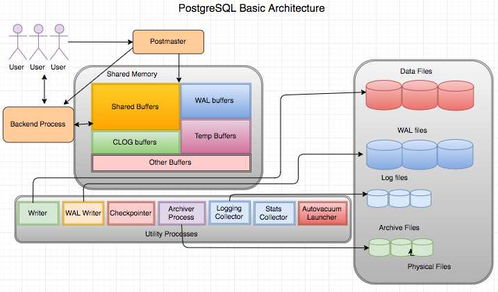

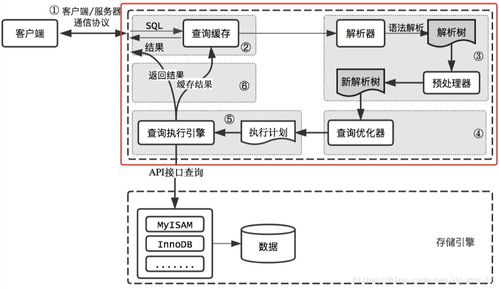

- 關系型數據庫(如MySQL、PostgreSQL):適合結構化數據、需要強一致性與復雜事務的場景(如用戶賬戶、交易系統)。

- NoSQL數據庫:

- 文檔型(如MongoDB):靈活存儲半結構化數據(如JSON),適合內容管理、產品目錄。

- 列式(如Cassandra、HBase):擅長快速讀寫海量數據,適用于時序數據、日志分析。

- 鍵值型(如Redis):提供極快的內存讀寫,常用于緩存、會話存儲。

- 圖數據庫(如Neo4j):專為關系網絡設計,適用于社交網絡、推薦引擎。

- 數據倉庫(如Snowflake、BigQuery):為大規模分析查詢優化,支持多維度聚合,是商業智能(BI)的核心。

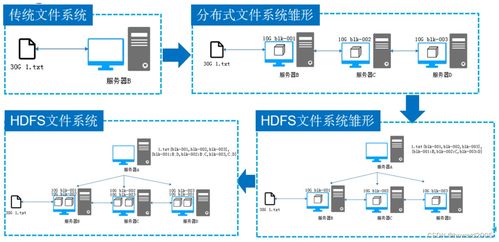

- 數據湖(如AWS S3、HDFS):以原始格式存儲海量異構數據(結構化、半結構化、非結構化),支持靈活的后處理分析。

選型時需權衡:數據模型、讀寫模式、一致性要求、擴展性及成本。

三、架構之爭:Lambda vs. Kappa

這兩種架構旨在處理大規模流式數據,但路徑不同:

- Lambda架構:包含批處理層(處理全量數據,保證高準確性)、速度層/流處理層(處理實時數據,保證低延遲)和服務層(合并兩者結果供查詢)。它穩健但復雜,需要維護兩套處理邏輯。

- Kappa架構:由Jay Kreps提出,簡化架構,只保留流處理層。所有數據(包括歷史數據回填)都通過流處理系統(如Kafka + Flink/Spark Streaming)處理,通過重播日志來實現批處理能力。它更簡潔,但對流處理引擎要求極高。

選擇建議:若業務對實時與批處理結果一致性要求極高,且團隊能承受復雜度,Lambda架構仍具價值。若追求架構簡潔,并相信流處理系統能覆蓋所有場景,Kappa是更現代的選擇。許多現代平臺(如Delta Lake、Apache Iceberg)正試圖融合兩者優勢。

四、數據處理與存儲支持服務

實際應用中,我們常依賴云服務或開源生態:

- 計算引擎:Apache Spark(批流一體)、Flink(高級流處理)、AWS Glue/EMR、Google Dataflow。

- 消息隊列/日志系統:Apache Kafka(數據管道核心),實現數據緩沖與異步處理。

- 存儲服務:對象存儲(AWS S3、Azure Blob)、云數據庫(RDS、Cosmos DB)、托管數據倉庫(Redshift、Snowflake)。

- 編排調度:Apache Airflow、Kubernetes,用于自動化工作流管理。

###

掌握數據存儲與計算,意味著你能夠為數據科學項目選擇合適的基礎設施,確保數據在流動中保持可用、一致與高效。從理解數據本身出發,到選擇數據庫與架構,每一步都影響著最終的分析效能與系統彈性。在后續課程中,我們將深入具體工具與實戰編碼,將概念付諸實踐。